La inteligencia artificial continúa avanzando a un ritmo vertiginoso y está adquiriendo cada vez más protagonismo en la vida cotidiana de las personas. Si bien ya es utilizada en campos como la ingeniería, el arte, la ciencia y la escritura, ahora también está incursionando en el contenido para adultos.

Sin embargo, esto plantea un problema: ¿cómo podemos estar seguros de que las imágenes que vemos son reales y no simplemente avatares generados por inteligencia artificial con fines eróticos?

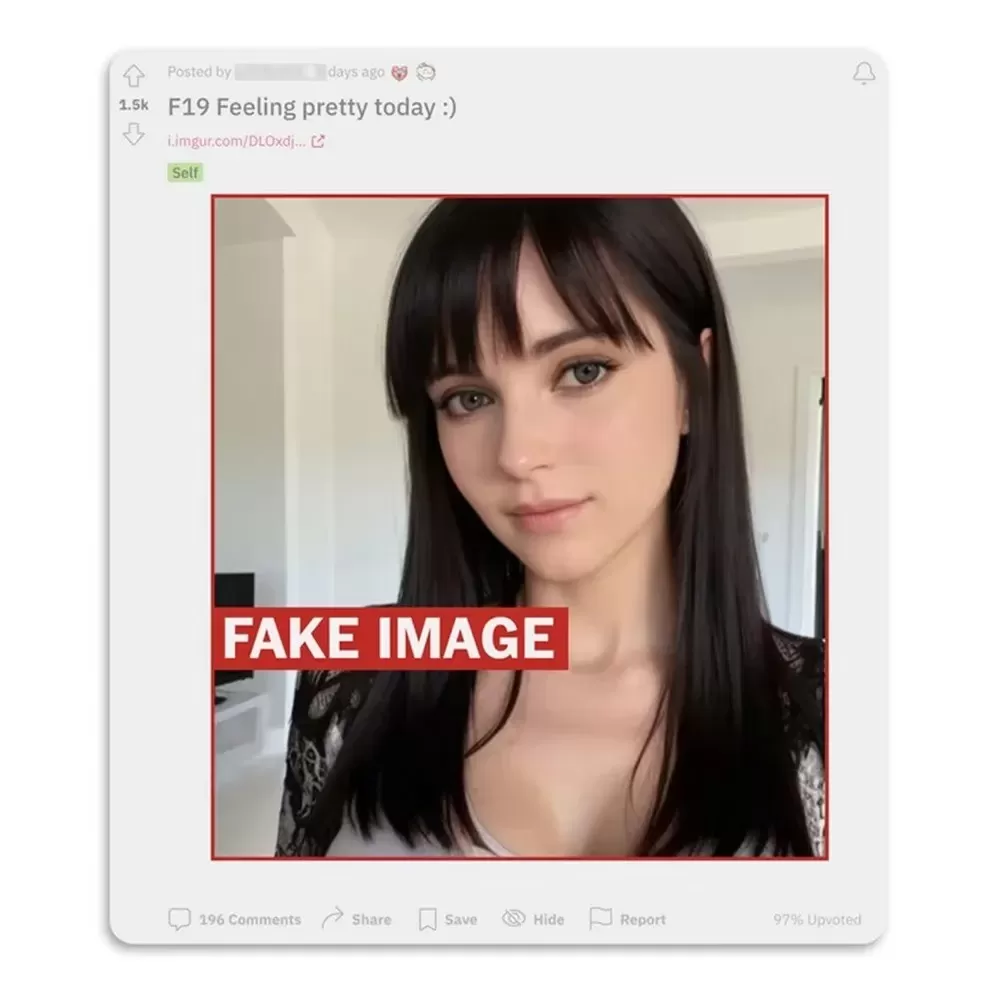

Un ejemplo de esto es “Claudia“, una joven de pelo negro largo que ofrece vender fotos de sus desnudos a coordinar por mensaje privado. Pero la verdad es que las imágenes que se ofrecen en este sitio web son falsas, creadas por generadores de imágenes de inteligencia artificial como Midjourney y Stable Diffusión.

Si bien estas imágenes pueden ser difíciles de detectar para el ojo inexperto, existen algunos defectos de fondo y detalles como lunares que aparecen y desaparecen que pueden ser claves para descubrir la falsedad de las mismas.

Los investigadores de este fraude han encontrado imágenes falsas en sitios web como Instagram, Reddit, Twitter y OnlyFans, que invitan a los usuarios a pagar por contenido de mayor erotismo. Esto ha llevado a algunos usuarios a sentirse engañados después de haber comentado en estas fotos, como el usuario de Reddit legalbeagle1966, quien había comentado que “Claudia” parecía “bastante sexy y perfecta“.

Si bien los especialistas en inteligencia artificial afirman que cualquiera puede crear una imagen falsa con una simple descripción y de manera gratuita, surge la preocupación de que estas imágenes perfeccionadas puedan suplantar a personas reales y perjudicarlas en su imagen pública.

Incluso, la nueva tecnología permite editar la foto de una persona vestida para dejarla expuesta al desnudo, lo que aumenta la preocupación por los malos usos que se le puedan dar.

La inteligencia artificial ha ingresado también en el mercado porno, lo que hace que lo real y lo ficticio estén cada vez más supeditados a la imagen en la tecnología que avanza mucho más rápido que una normativa que la regule.

Cómo detectar imágenes creadas con Inteligencia Artificial (IA)

Se ha hablado mucho sobre el avance de la inteligencia artificial en el ámbito de la creación de imágenes y su potencial para provocar desinformación. En este sentido, ha surgido una plataforma llamada “AI or Not“, que tiene como objetivo detectar qué imágenes fueron creadas por la tecnología.

La difusión de imágenes falsas de referentes mundiales como Trump y el Papa Francisco ha generado gran interés en la tecnología de inteligencia artificial aplicada a la creación de imágenes. Las imágenes fueron creadas por plataformas como DALL-E y Midjourney, que a través de una barra de búsqueda permiten ingresar indicaciones para que la IA cree una imagen relacionada con lo pedido por el usuario.

Por el momento, se puede notar que las imágenes son falsas debido a su alto grado de saturación, pero en el futuro, la calidad de los contenidos podría mejorarse y provocar una oleada de desinformación. Con esto en mente, la empresa privada Optic ha desarrollado una plataforma para detectar imágenes generadas por la inteligencia artificial.

La plataforma, llamada “AI or Not“, se encarga de analizar las imágenes presentadas por el usuario y determinar si fueron creadas por la inteligencia artificial. Al ingresar a la web, el usuario debe cargar una imagen JPEG o PNG y obtendrá un resultado presentado en valores porcentuales.

Aunque recién se encuentra en su primera etapa, AI or Not ya ha demostrado ser una herramienta efectiva para detectar imágenes creadas por plataformas como DALLE y Midjourney. Además, se espera que en el futuro, esta tecnología se utilice como herramienta para el chequeo de información y la detección de desinformación en la red.

En conclusión, la tecnología de inteligencia artificial aplicada a la creación de imágenes tiene un gran potencial para generar desinformación en la red. Por esta razón, herramientas como “AI or Not” se vuelven cada vez más importantes para detectar imágenes falsas y proteger la veracidad de la información. Es importante seguir de cerca el desarrollo de esta tecnología y su aplicación en la creación de contenidos en la red.

Leé más notas de La Opinión Austral

Compartir esta noticia